《测绘学报》遥感影像要素提取的可变结构卷积神经网络方法

遥感影像要素提取的可变结构卷积神经网络方法 王华斌1,2, 韩旻1,2, 王光辉2, 李玉1 摘要:针对利用经典卷积神经网络提取遥感影像地物要素的方法中,模型容量受既定网络固有结构的限制而难以得到良好提取效果的问题,提出利...

- 作者:王华斌,韩旻,王光辉,李玉来源:《测绘学报》|2019年07月10日

近年来,以卷积神经网络模型为典型代表的深度学习技术带动了遥感影像要素提取研究的迅速发展[1-2]。相较于传统的人工定义指数和浅层机器学习方法[3-6],卷积神经网络模型通过对海量图像的深层特征建模实现了图像信息的有效提取[7],在非样本数据集上的泛化能力显著增强。因此,基于卷积神经网络的遥感影像要素提取成为研究热点。

基于卷积神经网络模型的遥感影像要素提取方法通常利用包含卷积操作的神经网络模型描述影像与要素的类属关系,进而利用随机梯度下降算法求解模型中的未知参数[8]。按照要素提取的粒度,利用卷积神经网络模型的要素提取研究主要分为3个层次[9]:图像层的场景分类、像素层的影像分割和目标层的实例分割。

文献[10]提出的LeNet,将卷积操作引入神经网络模型,也是现代卷积神经网络模型的原型。该模型利用2次重复的卷积、下采样和3次全连接对图像的深层特征进行建模,在文本数字图像识别领域得到了有效应用。但由于卷积操作的计算代价过于高昂且缺乏明确的理论基础,该算法在提出后并未引起学界的关注。文献[1]提出的AlexNet以绝对优势荣获2012年ImageNet竞赛的冠军,加之低价的图形处理单元(GPU)提供了充足的计算资源,引起研究人员对于卷积神经网络模型的广泛关注。文献[11]利用AlexNet提取多尺度遥感影像的深层卷积特征,并对其进行特征编码以获取全局表征,结合支持向量机(support vector machine,SVM)分类影像所属的场景类别,是卷积神经网络模型在遥感领域的探索。文献[12]提出了一种结合显著性检测与稀疏自编码器的显著要素稀疏特征非监督提取算法,结合SVM准确地区分出了遥感影像的场景类别。然而,以场景分类为目标的要素提取结果受影像边界的制约,无法顾及影像中非主要类别的要素。

文献[13]提出的FCN(fully convolutional networks)是一种支持逐像素分类的卷积神经网络结构,将分割粒度由图像层细化到像素层。在该网络结构中,原本用于分类的卷积神经网络中的全连接层被替换为卷积层和转置卷积层,并加入了多个跨越连接。由于网络中间层全部为(转置)卷积层,训练所需的数据量较大,训练时间长,分割边缘不够清晰。针对这一问题,文献[14]引入数据增强技术并提出了U-Net。该网络先通过多个卷积、池化层提取高度抽象的深层特征,再通过转置卷积和卷积操作还原背景信息,同时利用带有裁切的跨越连接细化分割边缘。数据增强技术显著减少了模型训练时所需的样本数量,然而裁切和卷积操作降低了输出标记图像的空间分辨率,模型训练缓慢的问题依然存在。文献[15]将端到端的影像分割网络抽象分解为编码器、解码器和像素分类层,并且引入了利用最大池化指数的上采样层和批标准化层[16]定义SegNet。该网络结构通过边缘补零的卷积操作统一了输出标记图像与输入图像的空间分辨率,通过批标准化层缩短了训练所需的时间。但是该网络利用Softmax层作为像素多类别分类器,其类别间的竞争影响了分类结果,平均像素分类精度仍然有待提高。

文献[17]提出的R-CNN率先将候选区生成过程、卷积神经网络与支持向量机(SVM)结合用于目标检测问题。在该研究中,卷积神经网络模型主要负责候选区的特征提取,与其他过程耦合较为松散。其续作Fast R-CNN通过多任务损失(multi-task loss)建立了分类与包围盒修正网络[18]。在此基础上,Faster R-CNN将候选区生成过程替换为候选区生成网络[19]。至此,卷积神经网络模型完整地覆盖了目标检测任务的各个阶段。受Faster R-CNN启发,文献[20]提出的Mask R-CNN在原有架构的基础上增添了目标掩膜预测分支,从而将目标的检测、分类、分割纳入到统一的卷积神经网络模型中。该网络由多个部分构成,第1部分是残差连接网络(ResNet50或101)与特征金字塔网络(feature pyramid network)组成的特征提取网络,第2部分是候选区生成网络(region proposal network),第3部分是感兴趣区分类、位置修正及分割网络。特征网络首先提取图像多个尺度的特征,并由候选区生成网络直接在卷积特征层直接生成感兴趣区域,最后由分类及分割网络对感兴趣区域中的目标进行分类和分割。相关试验表明该模型能够十分准确地标注并分割出图像中的地物。然而,目标层的要素提取适用于独立特殊地物[21](如房屋、机场等)的提取,而对成片的大面积要素(如耕地)的提取支持较弱。

在卷积神经网络模型中,网络的结构定义是关键。上述几种方法虽然提取粒度不同,但普遍采用固定结构的卷积神经网络构造要素提取模型,网络的表达能力受到固定结构的制约。另一方面,固定结构网络的设计完全由专家依据专业知识手动定义,自动化水平低。针对以上问题,本文以像素层为要素提取粒度,将卷积神经网络的结构纳入要素提取问题的数学模型中,提出了基于可变结构卷积神经网络的遥感影像要素提取方法。本文方法将卷积神经网络中的关键结构作为变量,将形式化模型的要素提取指标作为目标函数。目标函数的最优解对应为关键结构最优的卷积神经网络模型。由于该目标函数对于网络中关键结构的导函数不可求取,采用遗传算法搜索最佳关键结构。对于遗传算法列举出的每个网络模型,基于传统交叉熵目标函数和梯度下降算法求解其中的未知参数,并以网络的要素提取性能作为相对应个体的适应性度量。最后,通过试验证明了本文方法的有效性。

1 方法描述 1.1 模型变量1.1.1 数据变量

约定影像张量X=[xn, h, w, c]N×H×W×C,其中xn, h, w, c为灰度值,其下标代表4个维度,n为影像索引,h为像素高度位置索引,w为像素宽度位置索引,c为像素光谱通道索引,Y=[yn, h, w, 0]N×H×W×1是像素类属目标要素的布尔标记。则对于某一类别的要素(如道路),已知数据集可表示为

(1)

(1)式中,UInt16={0, 1, …, 216-1};Boolean={0, 1}。

1.1.2 网络结构变量

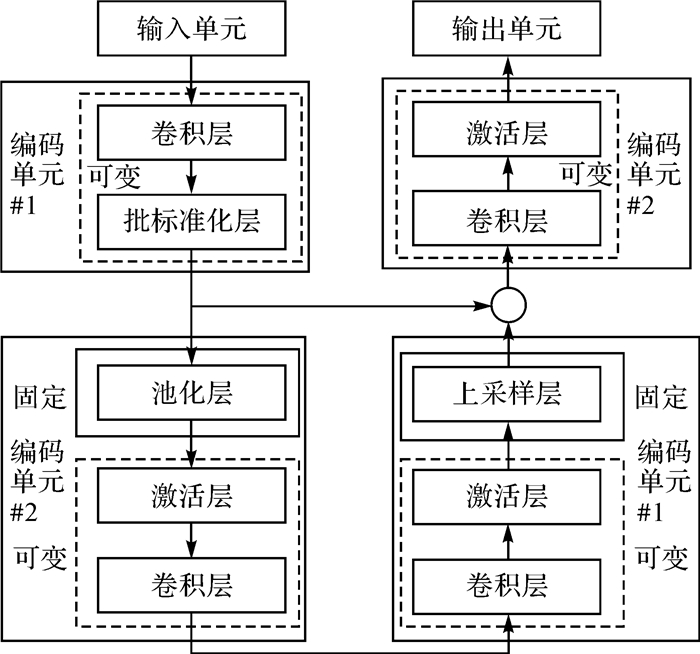

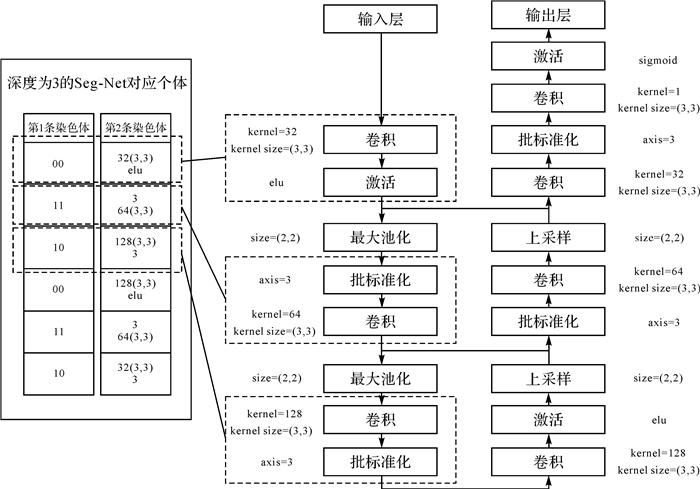

考虑要素提取粒度为像素层,必须对卷积神经网络模型的架构进行约束。本文选定编码器解码器网络作为基本架构。典型的编码器、解码器网络包括U-Net和SegNet。SegNet可以描述为带有跨越连接的编码器和解码器操作序列,其中编、解码器中的不可变部分是网络骨架,可变部分为关键结构,符合本文方法的应用要求。同时,为了便于拓展,本文设计了类SegNet作为可变结构卷积神经网络的基础架构。一个简单的具备两个编码单元和解码单元的类SegNet如图 1所示。

|

| 图 1 具有两个编码单元和解码单元的类SegNet Fig. 1 A SegNet with 2-units encoder and 2-units decoder |

约定F代表类SegNet引入的全部操作序列,fij是其中的一个操作,下标i为操作的顺序索引,下标j为操作的种类索引,θij为fij引入的变量,ξij为fij引入的常量。可以将该网络模型表达为

(2)

(2)式中,Z(I)=[zn, h, w, 1(I)]N×H×W×1为像素类属目标要素的概率张量,即满足zn, h, w, 1(I)∈[0, 1]。引入F′⊂F表示类SegNet中编码单元与解码单元中可变部分的操作序列。

1.2 目标函数构建基于上述模型变量,形式化地定义要素分类指标平均Jaccard指数为目标函数

(3)

(3)式中

(4)

(4)式中,σ为概率阈值,一般按照经验设定为0.5。本文方法按照目标函数最大化准则求取最优F′,从而获得关键结构设计最优的卷积神经网络模型。

1.3 基于遗传算法的组合优化由于F′代表类SegNet中可变部分全部操作的一组序列,在已知数据D的条件下最大化目标函数问题可以转化为对F′的组合优化问题。遗传算法(genetic algorithm, GA)[22]是一种模仿生物种群进化过程的随机优化算法。对数据规模较大的组合优化问题,GA在求解非线性的函数优化问题等方面有良好的适用性[23]。因此,本文基于GA框架求解对F′的组合优化问题。利用GA求解编码单元和解码单元组合优化问题的关键步骤在于可行解的编码、种群初始化设定、个体适应度的定义和遗传算子的设计。

1.3.1 可行解的编码

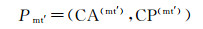

本文利用一个个体P代表一组可行解,由结构染色体CA和超参数染色体CP组成

(5)

(5)结构染色体由一组结构基因AUu组成,超参数染色体由一组超参数基因PUu组成,下标u为基因位置索引, U为基因长度,取偶数

(6)

(6)结构基因是一组二进制数,可通过映射字典对应编码单元或解码单元中的操作类型,超参数基因是设置操作的超参数,例如卷积核数量、卷积核大小和激活函数名称等。为了对可行解的编码过程进行更加清晰的阐述,举例如下。

表 1 列出基因-结构单元的映射字典。根据表 1给出数据,当取U=6,类SegNet编码过程可得如图 2所示网络结构。

| AU | PU | 结构单元 | |||

| 1 | 2 | 1 | 2 | ||

| 00 | 卷积核 | 激活函数 | 卷积 | 激活 | |

| 01 | 激活函数 | 卷积核 | 激活 | 卷积 | |

| 10 | 卷积核 | 批标准化轴 | 卷积 | 批标准化 | |

| 11 | 批标准化轴 | 卷积核 | 批标准化 | 卷积 | |

|

| 图 2 类SegNet的个体编码过程 Fig. 2 The code of individual and corresponding SegNet |

在图 2右侧所示的类SegNet中,第1个编码单元的定义是先卷积层后激活层,其中卷积操作的卷积核数为32,卷积核大小为(3, 3),激活操作的激活函数为elu(文献[24]),对应到结构染色体中第1个结构基因为00,超参数染色体中第1个超参数基因为((32, (3, 3)), (elu)),其余单元可依次类推,最终形成左侧的个体。

1.3.2 种群初始化设定

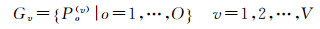

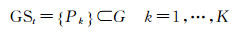

设Gv表示第v世代所有个体的集合

(7)

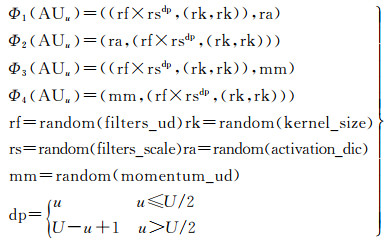

(7)式中,o为个体索引; O为个体总数; v为世代索引; Po(v)为第v世代编号为o的个体。引入卷积核数量集合filters_ud,卷积核数量与单元网络深度比例因子集合filters_scale,卷积窗口宽高集合kernel_size,激活函数字典集合activation_dic,批标准化动量集合momentum_ud。记random为随机从集合抽取一个元素的函数,对于o=1, …, O, u=1, …, U,初始化的种群个体表示为

(8)

(8)式中,AUu(0, o)=(random({0, 1}), random({0, 1}));PUu(0, o)=Φ(AUu(0, o))。Φ是根据结构基因初始化对应超参数基因的函数,可依据基因-结构单元映射字典和AUu定义。利用表 1给出的基因-结构单元映射字典,Φ示例为

(9)

(9)式中

(10)

(10)1.3.3 个体适应度定义

考虑到GA中的个体数量较多,为降低估计个体适应度所需的计算量,本文采用数据抽样和不充分训练的策略计算个体适应度。

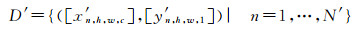

数据抽样策略假定已知数据集D是均匀的,对其抽样N′张影像和标注,形成抽样数据集D′⊂D,

(11)

(11)约定操作序列F′对应的个体为P′,则将D′和F′(代入式(3)定义为个体P′的适应度。由此,为了计算适应度函数,需要计算F′中操作引入的未知参数θ′ij。本文借助传统卷积神经网络求解方式,定义经验损失函数为

(12)

(12)在经验损失函数最小化准则下,利用自适应低阶矩的随机一阶梯度下降算法[25]。在固定数据遍历次数和附加提前停止的条件下,求解模型中未知参数的数值解。由此,可实现以较小的计算成本初步估计网络的表达能力。

1.3.4 遗传算子的设计

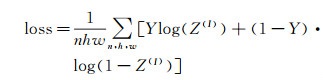

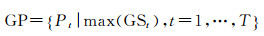

(1) 随机联赛选择算子。对当前世代G,随机选取K个个体作为参加联赛的个体集合GSt,以t表示联赛次数索引

(13)

(13)将每次联赛中适应度最优的个体保留,组成抚育下一种群的候选GP

(14)

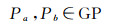

(14)(2) 单点交叉算子。将选择出个体按奇偶顺序两两配对,分别作为父代和母代

(15)

(15)式中,a=1, 3, …, T-1;b=2, 4, …, T。以一定概率αco交换父母代染色体中的部分基因,即

(16)

(16)式中,P′a与P′b为交换后的个体;CA′a、CP′a、CA′b、CP′b为交换后的染色体;β为交换位置起点,δ为交换部分基因长度,β与δ均在可行域内取随机数。得到交换后的种群GE

(17)

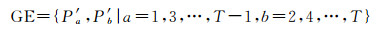

(17)(3) 基本位变异算子。染色体交叉后种群中的每个个体以一定概率αmt发生基本位的变异。假设Pmt为概率判定要发生基本位变异的个体

(18)

(18)对其结构染色体CA(mt)中每个基因按一定概率αfp重新初始化。假设AUγ(mt)为概率判定要发生变异的结构基因

(19)

(19)则重新初始化后结构基因

(20)

(20)由于AUγ(mt)发生变化,超参数染色体CP(mt)相同位置的超参数基因PUγ(mt)也必须相应改变。将AUγ(mt′)代入式(9),将PUγ(mt)重新初始化为PUγ(mt′)。由此得到CA(mt′)和CP(mt′),合并后表示变异后个体Pmt′

(21)

(21)1.3.5 方法流程

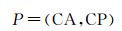

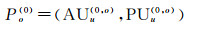

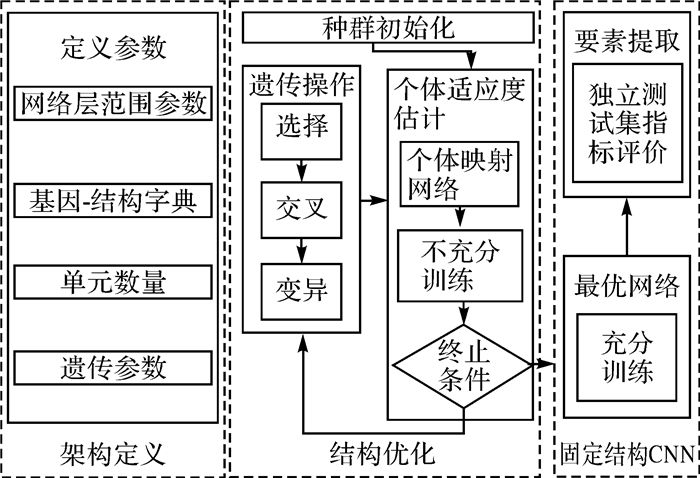

综合以上概念,本文方法分解为3个部分,第1部分为架构定义,第2部分为结构优化,第3部分为固定结构CNN的要素提取。流程如图 3所示,描述如下:

|

| 图 3 本文方法流程 Fig. 3 The flowchart of the proposed method |

步骤1:定义参数。包括网络层范围参数、基因结构字典设计、单元数量和遗传参数等。

步骤2:初始化种群。设定随机初始化种群个体的染色体。

步骤3:估计每个个体的适应度。将种群中每一个个体映射为类SegNet卷积神经网络,采用数据抽样和不充分训练的策略求解模型未知参数,计算目标函数值作为个体适应度。

步骤4:进化终止条件判定。判断最佳个体适应度是否达到预期值或达到限制的最大进化世代数。若满足停止条件则转向步骤9,否则进入步骤5。

步骤5:选择运算。将随机联赛选择算子作用于种群。

步骤6:交叉运算。将单点交叉算子作用于种群。

步骤7:变异运算。将基本位变异算子作用于种群,由此得到下一代种群。

步骤8:返回步骤3。

步骤9:报告最优个体。最优个体映射的类SegNet卷积神经网络结构即为求解得到的决策函数族,在取消数据抽样和不充分训练策略的条件下求解模型未知参数。

步骤10:利用求取的模型对遥感影像中的要素进行提取。本文这里采用方法在独立测试集上的指标进行效果评估。

2 试验和分析 2.1 试验设定为了验证本文方法的有效性,研究基于DSTL竞赛数据集中的遥感影像和10种要素标记,利用本地交叉验证[26]的策略评估本文方法的可靠性。

DSTL数据集是以World-View3卫星所拍摄的遥感影像为基础制成的要素标记数据集,提供了57个区域的遥感影像,其中25个区域包含居民地、沥青道路、林木与河流等10种要素标记。每个区域提供空间分辨率为31 cm的融合后RGB遥感影像、空间分辨率为31 cm的全色遥感影像、空间分辨率为1.24 m的多光谱8波段遥感影像及空间分辨率为7.5 m的短波8波段遥感影像。

数据准备过程如下:①将25张影像及其对应的地物要素类别图划分为17张模型训练集与8张独立测试集;②在模型训练集中,对每种地物要素生成与8波段多光谱影像长宽相同的目标要素标记二值图像;③将模型训练集中8波段多光谱影像与目标要素标记二值图像裁切成大小相同的图块,影像图块与其对应的二值标记图块称为一组;④对所有的组抽样32%作为抽样集,其余作为余样。表 2为各组数据集中的组数量。

| 集合 | 模型训练集 | 独立测试集 | |

| 影像/张 | 17 | 8 | |

| 要素类别 | 要素训练集/组 | ||

| 抽样集 | 余样集 | 总计 | |

| 建筑物 | 102 | 215 | 317 |

| 混杂附属物 | 98 | 208 | 306 |

| 沥青道路 | 98 | 206 | 304 |

| 非沥青道路 | 96 | 205 | 301 |

| 林木 | 114 | 241 | 355 |

| 耕地 | 121 | 257 | 378 |

| 河流 | 100 | 212 | 312 |

| 湖泊 | 98 | 206 | 304 |

| 大型车辆 | 100 | 212 | 312 |

| 小型车辆 | 98 | 207 | 305 |

试验使用表 3所示的基因-结构单元映射表,不充分训练的具体设定是固定数据遍历次数为70,批张量大小设定为2。为了避免计算时间过长,在试验中设定最大进化数V为200代。卷积核数量候选集filters_ud为{3, …, 16},卷积核窗口大小kernel_size为{1, 2, 3},卷积核数量随深度变化系数filters_scale为{2, 3, 4, 5},激活函数候选集{'elu', 'selu', 'relu', 'tanh', 'softplus', 'softsign', 'sigmoid', 'hard_sigmoid'},批标准化动量集{0.8, 0.81, …, 0.99}, 失活率集{0.5, 0.51,…, 0.99},种群规模O为20,联赛规模K为3,染色体交叉概率αco为0.5,基因变异概率αmt为0.02。卷积神经网络模型中权重求解的收敛条件为损失小于0.001或超过2000次数据遍历。

| AU | PU | 结构单元 | |||||

| 1 | 2 | 3 | 1 | 2 | 3 | ||

| 000 | 卷积核 | 动量系数 | 激活函数 | 卷积 | 批标准化 | 激活 | |

| 001 | 卷积核 | 激活函数 | 动量系数 | 卷积 | 激活 | 批标准化 | |

| 010 | 激活函数 | 动量系数 | 卷积核 | 激活 | 批标准化 | 卷积 | |

| 011 | 激活函数 | 卷积核 | 动量系数 | 激活 | 卷积 | 批标准化 | |

| 100 | 动量系数 | 激活函数 | 卷积核 | 批标准化 | 激活 | 卷积 | |

| 101 | 动量系数 | 卷积核 | 激活函数 | 批标准化 | 卷积 | 激活 | |

| 110 | 卷积核 | 激活函数 | 失活率 | 卷积 | 激活 | 失活 | |

| 111 | 卷积核 | 动量系数 | 失活率 | 卷积 | 批标准化 | 失活 | |

试验的硬件环境为Intel(R) Core(TM) i7-7700 HQ 2.80 GHz,NVIDIA Quadro M1200和Intel(R) Xeon(R) E5-2630U3 2.40 GHz,4块NVIDIA Tesla M40,软件环境为Python 3.5.2,主要依赖库为Tensorflow1.4.0,Keras2.0.8。

2.2 试验结果2.2.1 遗传过程

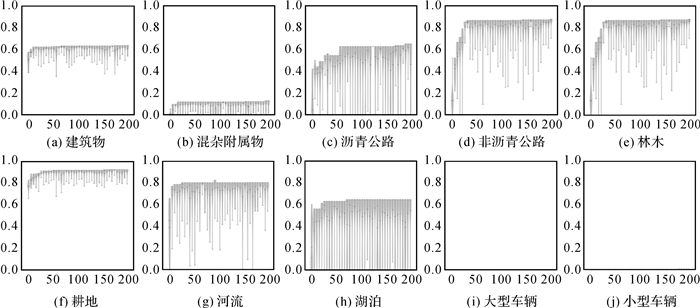

利用可变结构卷积神经网络模型对10种要素提取过程建模并进行试验,图 4反映了结构优化过程中种群适应度与进化世代数之间的关系。其中,种群适应度分布由小提琴宽度表示,种群适应度上下限由小提琴上下顶点表示。对进化过程中种群适应度绝对值的观察显示,长度为6的类SegNet架构对不同要素的提取表现不同,体现为耕地要素提取网络的绝对提取效果最高,非沥青公路要素提取网络次之,之后依次是河流、沥青公路、林木、湖泊、建筑物,小型车辆、大型车辆。

|

| 图 4 10种要素网络模型结构优化遗传过程小提琴图 Fig. 4 The violin figures of evolution of CNN architectures for ten features |

从种群进化过程前后个体适应度的相对变化来看,多数要素提取网络的表达能力在进化过程后都得到了一定程度的优化(表 4)。分析表 4数据可以看出,个体适应度优化的幅度与要素种类相关,例如提取河流、沥青公路、非沥青公路的指标优化幅度在0.15至0.35之间,而提取建筑物、混杂附属物、林木、耕地、湖泊的指标优化幅度均在0.10以内,大型车辆、小型车辆的提取指标在优化前后并未有所提升。由此得出结论:在长度为6的类SegNet架构约束下,网络结构优化过程对不同要素的适用性不同,对非沥青公路、沥青公路、河流的要素提取网络的结构优化较为有效,而对建筑物、混杂附属物、林木、耕地的网络优化效果有限。对于大型车辆和小型车辆而言,提取模型的绝对指标几乎为0,并且优化结构也不能获得任何提升,因此可以判断网络结构并非提取该类特殊要素的制约条件。

| 要素 | 初代最优个体 | 末代最优个体 | 优化幅度 |

| 建筑物 | 0.575 | 0.638 | 0.063 |

| 混杂附属物 | 0.057 | 0.132 | 0.075 |

| 沥青公路 | 0.421 | 0.653 | 0.232 |

| 非沥青公路 | 0.522 | 0.880 | 0.358 |

| 林木 | 0.575 | 0.651 | 0.077 |

| 耕地 | 0.825 | 0.925 | 0.099 |

| 河流 | 0.658 | 0.805 | 0.147 |

| 湖泊 | 0.601 | 0.648 | 0.048 |

| 大型车辆 | 0.000 | 0.002 | 0.002 |

| 小型车辆 | 0.001 | 0.007 | 0.006 |

2.2.2 最终网络

取结构优化过程中末代网络的最优个体,并映射为所对应的最终网络,表 5为10种要素的可变结构卷积神经网络的最终结构。B、C、A分别表示批标准化层、卷积层、激活层,后面附加的是该层所需的超参数。(C-卷积核数量,卷积窗口大小,B-动量系数,A-激活函数)。

| 结构 | 最终结构 | |||||||||

| 建筑物 | 混杂附属物 | 沥青公路 | 非沥青公路 | 林木 | 耕地 | 河流 | 湖泊 | 大型车辆 | 小型车辆 | |

| EU1 | B-0.83 | B-0.99 | C-32, 3 | B-0.94 | C-28, 2 | C-16, 3 | C-26, 3 | B-0.91 | B-0.85 | A-tanh |

| C-32, 3 | A-tanh | A-hard sigmoid | C-16, 3 | A-hard sigmoid | A-elu | B-0.83 | C-30, 2 | A-elu | C-22, 2 | |

| A-softsign | C-14, 3 | B-0.96 | A-tanh | B-0.85 | B-0.82 | D-0.56 | A-elu | C-22, 5 | B-0.91 | |

| EU2 | A-relu | B-0.82 | B-0.89 | A-hard sigmoid | B-0.85 | B-0.87 | A-selu | A-tanh | C-56, 4 | B-0.97 |

| C-28, 2 | A-elu | A-relu | C-64, 3 | A-softplus | A-relu | C-44, 3 | C-56, 2 | A-selu | C-40, 3 | |

| B-0.81 | C-40, 3 | C-44, 3 | B-0.92 | C-40, 3 | C-32, 5 | B-0.99 | B-0.87 | D-0.82 | A-sigmoid | |

| EU3 | A-relu | C-56, 3 | A-relu | C-96, 5 | B-0.84 | A-relu | B-0.97 | A-selu | B-0.88 | C-24, 3 |

| C-72, 3 | B-0.94 | B-0.84 | A-softplus | A-softplus | B-0.95 | A-tanh | B-0.9 | A-elu | A-tanh | |

| B-0.83 | A-relu | C-96, 5 | B-0.87 | C-128, 3 | C-112, 4 | C-112, 5 | C-40, 5 | C-112, 2 | D-0.79 | |

| DU1 | B-0.82 | C-24, 5 | A-hard sigmoid | C-64, 5 | B-0.98 | C-32, 4 | A-sigmoid | B-0.87 | B-0.93 | C-32, 5 |

| A-tanh | A-selu | C-104, 2 | A-relu | C-56, 5 | A-tanh | C-112, 2 | A-relu | A-softplus | A-hard sigmoid | |

| C-88, 3 | B-0.8 | B-0.89 | B-0.85 | A-relu | B-0.86 | B-0.92 | C-120, 5 | C-40, 4 | B-0.96 | |

| DU2 | B-0.95 | B-0.87 | B-0.82 | B-0.91 | C-48, 2 | A-softsign | B-0.98 | B-0.9 | C-40, 5 | C-36, 5 |

| A-relu | A-relu | A-relu | A-relu | A-relu | C-56, 5 | C-16, 2 | A-tanh | A-relu | A-sigmoid | |

| C-52, 5 | C-56, 3 | C-36, 3 | C-40, 5 | B-0.91 | A-relu | A-softplus | C-24, 3 | B-0.9 | B-0.93 | |

| DU3 | C-32, 4 | C-24, 4 | C-20, 4 | C-10, 3 | C-20, 5 | C-14, 4 | C-32, 4 | B-0.85 | C-6, 3 | A-tanh |

| B-0.9 | A-selu | B-0.96 | B-0.82 | B-0.8 | B-0.91 | A-sigmoid | A-hard sigmoid | A-relu | B-0.83 | |

| A-relu | D-0.73 | A-hard sigmoid | A-sigmoid | A-relu | A-relu | B-0.96 | C-12, 5 | D-0.74 | C-32, 4 | |

| 适应度 | 0.64 | 0.13 | 0.65 | 0.88 | 0.65 | 0.92 | 0.81 | 0.65 | 0.002 | 0.006 |

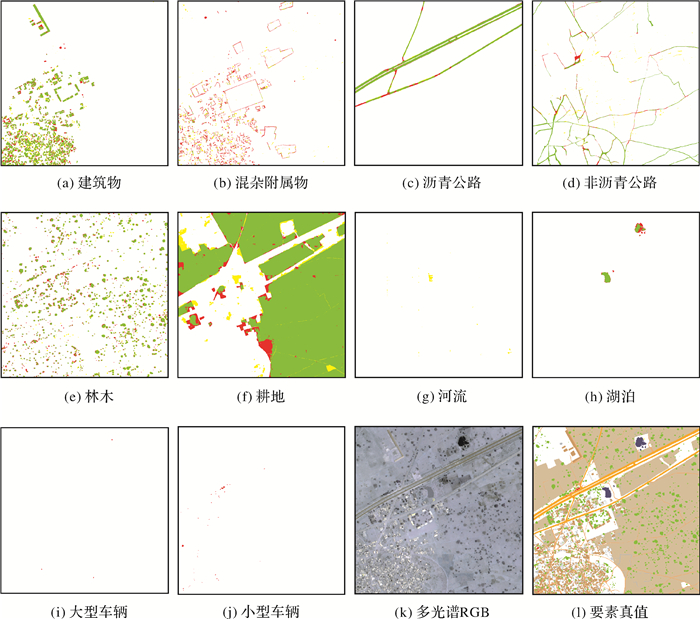

图 5(a) 为对多种要素提取网络模型中激活操作的函数统计频数。分析发现relu函数的出现频数显著高于其他函数,tanh次之,最少出现的是softsign。说明激活函数的选择上relu函数非线性激活的处理效率高于其他函数,通用性强于其他函数。

|

| 图 5 参数分析统计 Fig. 5 The statistics of parameters analysis |

建筑物、沥青公路、非沥青公路、林木、河流等要素的提取网络中,卷积核数量服从随深度递增的设定,图 5(b)的折线图呈现倒U形;而耕地、湖泊、混杂附属物、小型车辆、大型车辆要素提取网络中,卷积核数量并未服从随深度递增的设定。说明卷积核数量的设定受要素种类影响,并非完全服从随深度递增的规律。对卷积核窗口大小的统计显示宽度为3的卷积窗口频数较高,为22次;宽度为5的窗口出现了18次;宽度为4的出现了10次。说明宽度为3的卷积窗口较宽度为4的卷积窗口通用性更强。图 5(c)中批标准化操作中动量系数按要素种类不同呈现3种分布:混杂附属物和沥青公路的要素提取网络中,动量系数呈现W形,非沥青公路、耕地、河流、湖泊的要素提取网络中,动量系数呈现M形,其他要素提取网络中,动量系数在编码器阶段变化幅度不大,而在解码阶段剧烈变化,呈现倒扣的勺状。Dropout处理出现在混杂附属物、河流、大型车辆、小型车辆4种要素提取网络中。说明模型优化过程对多光谱特征较为复杂的要素会利用Dropout的模型平均作用来尝试提高其提取效果。

2.2.3 提取效果

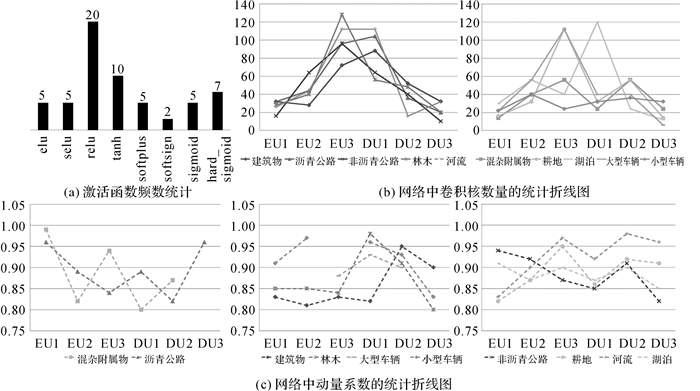

图 6 为独立测试集上一张影像按本文方法提取要素的效果。其中要素真值与预测值的真正(true positive)部分以绿色标记,假负(false negative)部分以红色标记,假正(false positive)部分以黄色标记,真负(true negative)部分以白色标记。

|

| 图 6 目标要素提取结果 Fig. 6 The extraction results of target surface features |

通过视觉观察,对于测试影像中的林木、非沥青公路、耕地、建筑物、沥青公路、湖泊要素,模型提取出了大部分目标区域,说明模型具备一定的分类泛化能力。由于河流要素未出现在示例图像中,模型的预测结果均为假正,说明对负样本的处理是模型实用化的关键。另一方面,模型对于混杂附属物、大型车辆、小型车辆要素的提取效果并不理想。究其原因是混杂附属物包含了多种建筑物附属结构,其像元光谱十分复杂导致模型难以区分。另外,多光谱影像的分辨率为1.24 m,这3类要素在影像上的图斑尺寸过小,客观上也增加了提取的难度。

将本文AVCNN方法与Logistic、SVM、SegNet模型进行对比,评价指标选取模型在独立测试集合(8张影像)上的Jaccard指数。必须说明的是,方法对要素负样本的正确提取将使得Jaccard指数无意义,在统计时被忽略,但对要素负样本的错误提取仍会被统计。这种统计方式会极大地降低无法对负样本做完全正确预测的模型的评分,本文将其称为Jaccard指数的负样本抑制统计效应。图 7为评价指标分布箱形图,表 6为各提取方法在测试集合上的平均指标。

|

| 图 7 4种方法在独立测试集Jaccard指数箱形图 Fig. 7 The box plots of Jaccard indexes of four methods on test set |

图 7 反映出AVCNN对多数要素的提取效果优于其他3种方法。在独立测试集中,仅有1张影像包含河流要素,Logistic模型通过负样本上的正确预测规避了平均Jaccard指数在统计上的负样本抑制效应,而本文方法虽然在正样本上的表现与Logistic模型相当(图 7(d)中河流要素的孤立点),但在负样本上产生了少量的错误预测,导致在统计的平均Jaccard指数上显著低于Logistic模型(表 6)。

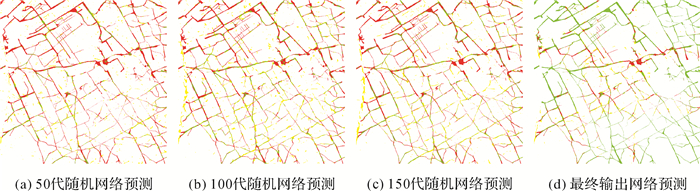

2.3 分析图 8 为遗传过程中多个网络模型对非沥青道路要素提取的对比。可以看出,第50、100、150代以及最终输出网络经充分训练在测试集的提取结果中,假负部分(红色部分)逐渐减少,真正部分(绿色部分)逐渐增多,提取效果逐渐提升,说明利用不充分训练估计模型表达力的策略是有效的。

|

| 图 8 遗传过程中类SegNet的性能改善 Fig. 8 The performance improvement of AVCNN in evolution |

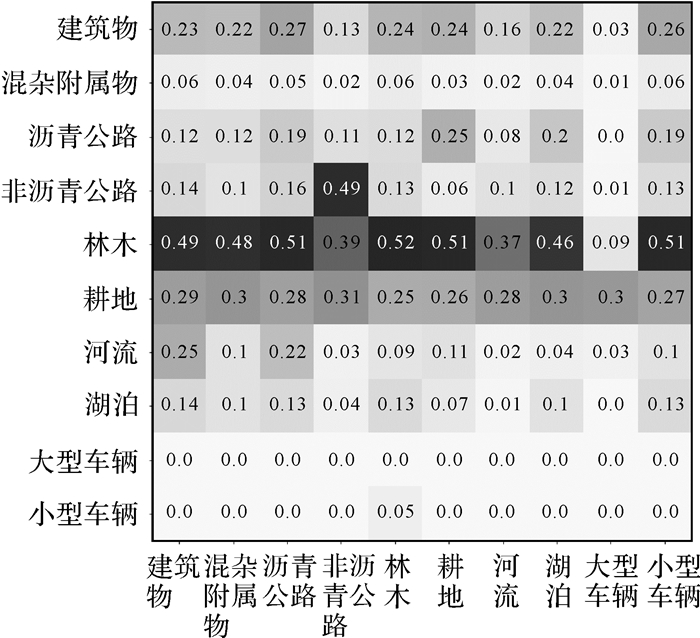

将本文方法得出各要素最终提取网络结构在要素间交叉地执行训练和提取,得到图 9所示的适配性矩阵(纵坐标代表网络权重训练所基于的要素索引,横坐标代表最终提取网络结构所基于的要素索引,坐标值为模型在独立测试集上的平均Jaccard指数)。由图中可以看出,遗传算法得到的网络结构与要素间的适配性与要素类型有关:对非沥青公路、林木两种要素,遗传算法得到的网络结构对其要素本身的提取是最优的,其中非沥青公路要素的网络与其他网络差异较为明显;对于建筑物、混杂附属结构、沥青公路,耕地、河流、湖泊、小型车辆等7种要素,遗传算法得到的网络结构对其要素本身的提取效果并非最优,但也具备相当的提取能力,说明本文方法表现出相当大的随机性,但能够作为求解具有一定容量的网络结构的方法;对于大型车辆,所有要素提取网络都未获得有效的提取效果,说明本文方法的适用性受限于数据条件和要素特点。综上,遗传算法对一种要素求解得到的网络结构对其他要素也具有一定的适应性,当目标地物发生变化时,重新利用遗传算法得到的新的网络可以获得具备一定容量的模型结构,但仍受要素特点与数据条件的限制。

|

| 图 9 各要素与解网络间的适配性矩阵 Fig. 9 The adaptive array of AVCNN of different features |

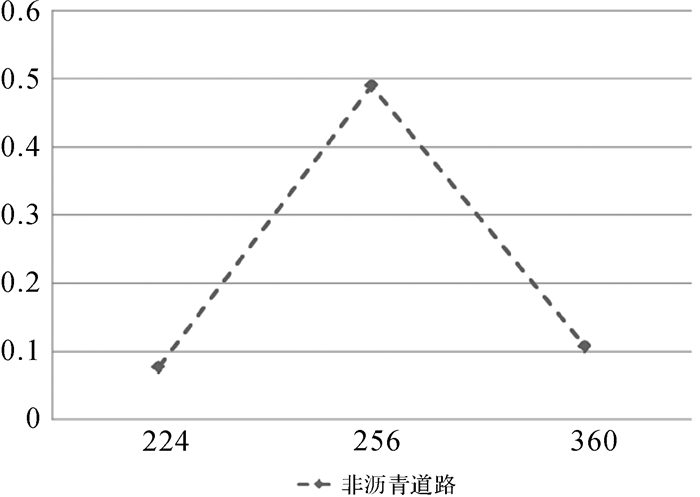

以非沥青道路为例,调整输入模型的影像块大小并对网络结构进行相应重构,得到影像块大小对最终网络结构提取效果的影响(图 10)。从图中可以看出,输入影像块大小会影响网络模型的预测效果。具体表现为随着影像块大小的增加,模型在独立测试集要素提取指标呈现先增后减的趋势。

|

| 图 10 影像块大小对模型性能影响 Fig. 10 The performance of models with different input size |

遥感影像的要素提取中,一般认为像素的类别具有唯一性。然而,在DSTL数据集中,部分要素的矢量数据在空间上存在重叠,例如林木与耕地,林木与非沥青公路等。这一部分重叠要素从影像中像元的光谱特征上难以分辨,但在逻辑上存在合理性。基于Softmax分类器的SegNet虽然架构简单,训练方便,但其所分像素具备类别上的排他性。因此本文认为针对每种要素建立像元的二值分类模型更加符合人类的主观认知和数据集特性。

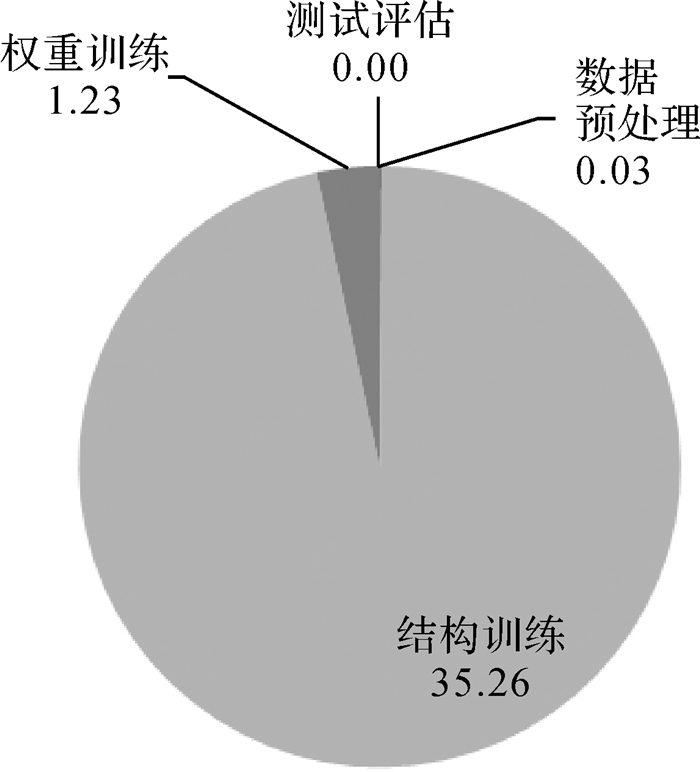

AVCNN的核心步骤是利用进化算法对卷积神经网络模型进行结构及参数的调优。进化算法的收敛效率低,卷积神经网络的训练时间长,都使得本次研究中AVCNN的时间成本异常高昂,在使用4块24 GB显存GPU的条件下,各步骤的平均时间消耗如图 11所示。事实上,现有关于网络结构自动化搜索的其他研究[28-31]都依赖于强大的硬件支撑。本文方法继承了进化算法的可并行特性、卷积神经网络模型的可分布式特性。因此可以结合分布式计算技术缩短方法的执行时间,提高方法的实用性。

|

| 图 11 本文方法各步骤的平均时间消耗/h Fig. 11 The average time consuming of our method/h |

3 结论

针对现有卷积神经网络模型多为人工固定定义,在提取遥感影像中的目标要素时表达能力受到固定结构制约且自动化水平低的问题,提出了基于可变结构卷积神经网络要素提取方法。本文面向遥感影像要素提取场景定义类SegNet架构,将其中的关键结构作为变量,将模型的要素提取精度作为目标函数,设计了适用于该优化问题的遗传算法以求解网络结构,最后依据求解后得到的网络结构提取遥感影像中的目标要素。得出以下结论:①以“定义架构而非定义结构,求解结构而非固定结构”为核心思想的可变结构卷积神经网络模型设计思想是可行的;②本文设计的GA能够作为求解具备一定容量的可变卷积神经网络中关键结构的一种实用方法;③相比传统固定结构卷积神经网络,可变结构卷积神经网络具备更加灵活的模型容量和更强的模型表达能力。在仅使用多光谱数据的条件下,基于可变结构卷积神经网络模型提取DSTL数据集中各要素的Jaccard指数均优于基于Logistic、SVM和SegNet模型的方法。更重要的是,可变结构卷积神经网络将结构定义提升到了架构定义,减少了网络设计过程对专家知识的依赖,是深度学习自动化方面的重要探索。然而,必须注意的是模型自优化算法普遍需要高密度的计算资源,需要与分布式计算集群配合才能满足一般的业务的时间需求。另外,本文方法仍然受限于卷积神经网络的基础架构和网络深度,要素分类的绝对精度仍然有限。如何将整体架构和网络深度也纳入网络结构优化选择的过程中是下一步研究的方向。

【引文格式】王华斌, 韩旻, 王光辉, 等. 遥感影像要素提取的可变结构卷积神经网络方法. 测绘学报,2019,48(5): 583-596. DOI: 10.11947/j.AGCS.2019.20180122

| [1] | KRIZHEVSKY A, SUTSKEVER I, HINTON G E. ImageNet classification with deep convolutional neural networks[C]//Proceedings of the 25th International Conference on Neural Information Processing Systems. Lake Tahoe. Nevada: ACM, 2012: 1097-1105. |

| [2] | ZANG Liangpei, ZHANG Lefei, DU Bo. Deep learning for remote sensing data:a technical tutorial on the state of the art[J]. IEEE Geoscience and Remote Sensing Magazine, 2016, 4(2): 22–40. DOI:10.1109/MGRS.2016.2540798 |

| [3] | 闫利, 江维薇. 一种利用结构特征的高分辨率遥感影像种植园自动提取方法[J]. 测绘学报, 2016, 45(9): 1065–1072. YAN Li, JIANG Weiwei. A structure feature for automatic extraction of plantation from high-resolution remote sensing imagery[J]. Acta Geodaetica et Cartographica Sinica, 2016, 45(9): 1065–1072. DOI:10.11947/j.AGCS.2016.20150511 |

| [4] | 郭军士.基于改进形态学指数的ZY3影像建筑物和阴影的提取及应用[D].西安: 西安科技大学, 2015. GUO Junshi. Extraction and application of building and shadow of ZY3 image based on improving morphological index[D]. Xi'an: Xi'an University of Science and Technology, 2015. http://cdmd.cnki.com.cn/Article/CDMD-10704-1016901980.htm |

| [5] | 张莹莹.高分辨率遥感影像中典型道路提取方法研究[D].哈尔滨: 哈尔滨工业大学, 2016. ZHANG Yingying. Research on methods of typical road extraction from high-resolution remote sensing image[D]. Harbin: Harbin Institute of Technology, 2016. http://cdmd.cnki.com.cn/Article/CDMD-10213-1016914341.htm |

| [6] | 李航. 统计学习方法[M]. 北京: 清华大学出版社, 2012. LI Hang. Statistical learning method[M]. Beijing: Tsinghua University Press, 2012. |

| [7] | 许夙晖, 慕晓冬, 赵鹏, 等. 利用多尺度特征与深度网络对遥感影像进行场景分类[J]. 测绘学报, 2016, 45(7): 834–840. XU Suhui, MU Xiaodong, ZHAO Peng, et al. Scene classification of remote sensing image based on multi-scale feature and deep neural network[J]. Acta Geodaetica et Cartographica Sinica, 2016, 45(7): 834–840.DOI:10.11947/j.AGCS.2016.20150623 |

| [8] | KAMPFFMEYER M, SALBERG A B, JENSSEN R. Semantic segmentation of small objects and modeling of uncertainty in urban remote sensing images using deep convolutional neural networks[C]//Proceedings of 2016 IEEE Conference on Computer Vision and Pattern Recognition Workshops. Las Vegas, NV: IEEE, 2016: 680-688. |

| [9] | ZHANG Fan, DU Bo, ZHANG Liangpei, et al. Weakly supervised learning based on coupled convolutional neural networks for aircraft detection[J]. IEEE Transactions on Geoscience and Remote Sensing, 2016, 54(9): 5553–5563.DOI:10.1109/TGRS.2016.2569141 |

| [10] | LECUN Y, BOTTOU L, BENGIO Y, et al. Gradient-based learning applied to document recognition[J]. Proceedings of the IEEE, 1998, 86(11): 2278–2324. DOI:10.1109/5.726791 |

| [11] | HU Fan, XIA Guisong, HU Jingwen, et al. Transferring deep convolutional neural networks for the scene classification of high-resolution remote sensing imagery[J]. Remote Sensing, 2015, 7(11): 14680–14707. DOI:10.3390/rs71114680 |

| [12] | ZHANG Fan, DU Bo, ZHANG Liangpei. Saliency-guided unsupervised feature learning for scene classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2015, 53(4): 2175–2184. DOI:10.1109/TGRS.2014.2357078 |

| [13] | SHELHAMER E, LONG J, DARRELL T. Fully convolutional networks for semantic segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(4): 640–651. DOI:10.1109/TPAMI.2016.2572683 |

| [14] | RONNEBERGER O, FISCHER P, BROX T. U-net: convolutional networks for biomedical image segmentation[C]//Proceedings of the 18th International Conference on Medical Image Computing and Computer-Assisted Intervention. Munich, Germany: Springer, 2015: 234-241. |

| [15] | BADRINARAYANAN V, KENDALL A, CIPOLLA R. Segnet:a deep convolutional encoder-decoder architecture for image segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(12): 2481–2495.DOI:10.1109/TPAMI.34 |

| [16] | IOFFE S, SZEGEDY C. Batch normalization: accelerating deep network training by reducing internal covariate shift[C]//Proceedings of the 32nd International Conference on Machine Learning. Lille, France: [s.n.], 2015: 448-456. |

| [17] | GIRSHICK R, DONAHUE J, DARRELL T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation[C]//Proceedings of 2014 IEEE Conference on Computer Vision and Pattern Recognition(CVPR).Columbus, OH: IEEE, 2014: 215-228. |

| [18] | GIRSHICK R. Fast R-CNN[C]//Proceedings of 2015 IEEE International Conference on Computer Vision. Santiago, Chile: IEEE, 2015. |

| [19] | REN Shaoqing, HE Kaiming, GIRSHICK R, et al. Faster R-CNN:towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137–1149.DOI:10.1109/TPAMI.2016.2577031 |

| [20] | HE Kaiming, GKIOXARI G, DOLLÁR P, et al. Mask R-CNN[C]//Proceedings of the 2017 IEEE International Conference on Computer Vision. Venice, Italy: IEEE, 2017: 2980-2988. |

| [21] | CHEN Fen, REN Ruilong, VAN DE VOORDE T, et al. Fast automatic airport detection in remote sensing images using convolutional neural networks[J]. Remote Sensing, 2018, 10(3): 443. DOI:10.3390/rs10030443 |

| [22] | HOLLAND J H. Adaptation in natural and artificial systems[M]. Cambridge, Massachusetts: MIT Press, 1992. |

| [23] | 李明.遗传算法的改进及其在优化问题中的应用研究[D].长春: 吉林大学, 2004. LI Ming. The study on improved genetic algorithm and its application in optimization questions[D]. Changchun: Jilin University, 2004. http://cdmd.cnki.com.cn/Article/CDMD-10183-2004099733.htm |

| [24] | CLEVERT D A C, UNTERTHINER T, HOCHREITER S. Fast and accurate deep network learning by exponential linear units (ELUs)[R]. International Conference on Learning Representations 2016. San Juan: ICLR, 2016. |

| [25] | KINGMA D P, BA J. ADAM: a method for stochastic optimization[C]//Proceedings of International Conference on Learning Representations 2015. San Diego: ICLR, 2015: 321-335. |

| [26] | TAN P, STEINBACH M, KUMAR V.数据挖掘导论[M].范明, 范宏建, 译.北京: 人民邮电出版社, 2011. TAN P, STEINBACH M, KUMAR V. Introduction to data mining[M]. FAN Ming, FAN Hongjian, trans. Beijing: Post & Telecom Press, 2011. |

| [27] | CHANG C C, LIN C J. LIBSVM:a library for support vector machines[J]. ACM Transactions on Intelligent Systems and Technology, 2011, 2(3): No.27. |

| [28] | MENDOZA H, KLEIN A, FEURER M, et al. Towards automatically-tuned neural networks[C]//Proceedings of JMLR: Workshop and Conference Proceedings.[S.l.]: JMLR, 2016: 58-65. |

| [29] | KANDASAMY K, NEISWANGER W, SCHNEIDER J, et al. Neural architecture search with Bayesian optimisation and optimal transport[C]//Proceedings of the 32nd Conference on Neural Information Processing Systems. Montréal, Canada: [s.n.], 2018. |

| [30] | ASSUNÇO F, LOURENÇO N, MACHADO P, et al. DENSER:deep evolutionary network structured representation[J]. Genetic Programming and Evolvable Machines, 2019, 20(1): 5–35. DOI:10.1007/s10710-018-9339-y |

| [31] | DUFOURQ E, BASSET B A. EDEN: evolutionary deep networks for efficient machine learning[C]//Proceedings of 2017 Pattern Recognition Association of South Africa and Robotics and Mechatronics International Conference. Bloemfontein, South Africa: [s.n.], 2017. |

【引文格式】王华斌, 韩旻, 王光辉, 等. 遥感影像要素提取的可变结构卷积神经网络方法. 测绘学报,2019,48(5): 583-596. DOI: 10.11947/j.AGCS.2019.20180122